728x90

반응형

캐글에서 TPU를 무료로 사용할 수 있다는 사실을 발견했는데요

주당 30시간, 회당 9시간까지 사용할 수 있다고 합니다!

캐글의 가이드를 다시 짚어보면서 TPU 사용법을 보려 합니다 :)

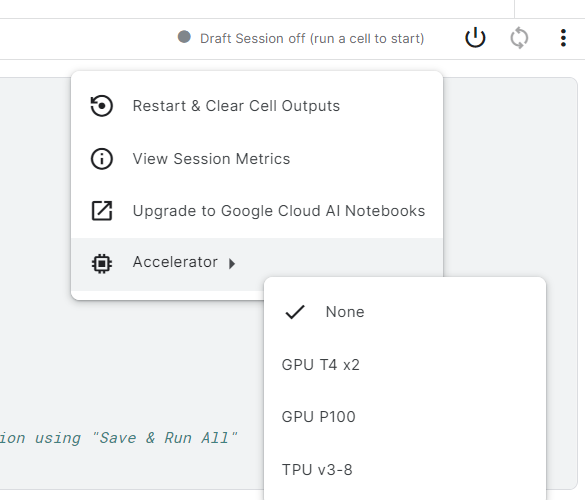

1. 캐글 Accelerator 에 TPU v3-8 설정하기

오른쪽 상단 점 3개를 누르고 TPU를 사용하겠다고 설정합니다.

2. 케라스를 이용한 TPU 사용

# detect and init the TPU

tpu = tf.distribute.cluster_resolver.TPUClusterResolver.connect()

tpu_strategy = tf.distribute.experimental.TPUStrategy(tpu)

with tpu_strategy.scope():

model = tf.keras.Sequential( … ) # define your model normally

model.compile( … )

model.fit(training_dataset, epochs=EPOCHS, steps_per_epoch=…)

TPU는 네트워크를 연결되어있기 때문에 연결을 위해 가장먼저 TPUClusterResolver.connect()를 해준다고 합니다.

이후에는 TPUStrategy를 인스턴스화 해서 TPU 작동을 위한 코드들을 포함한 객체를 만듭니다.

그리고 TPUStrategy를 이용해서 TPU에 모델이 돌아가도록 합니다.

모델을 만들고 훈련하는 구조는 기존 케라스 사용방식과 동일해서 생각보다 사용이 편리하게 되어 있는 것 같습니다.

Pytorch 를 통해 사용하는 방법은 링크 하단 내용을 참조해주세요

위 링크에는 TPU를 통해 훈련한 모델을 저장하는 법, 모델 로딩 하는 법 등 여러 정보를 담고 있으니 참고 바랍니당

Source:

TPU 사용 예시 코드 ↓

https://www.kaggle.com/code/ryanholbrook/exercise-create-your-first-submission/notebook

https://www.kaggle.com/docs/tpu

728x90

반응형

'Data Science > Deep Learning' 카테고리의 다른 글

| Tesnsorflow.cast 텐서 데이터 타입 변경하기 (0) | 2022.11.18 |

|---|---|

| Tesorflow JPEG 이미지 텐서로 변환하기 (0) | 2022.11.18 |

| Keras Layer 입력/출력 크기 구하는 법 (0) | 2022.11.16 |

| Keras fit_generator 대신 fit 사용하기 (0) | 2022.11.16 |

| Keras ReduceLROnPlateau 클래스 (0) | 2022.11.15 |

댓글